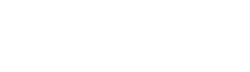

Quick Draw a través de Google Neural Net (sí, cacahuetes / maníes es lo que intentó adivinar GNN sin suerte ¡y estaba clarísimo! 🙂 )

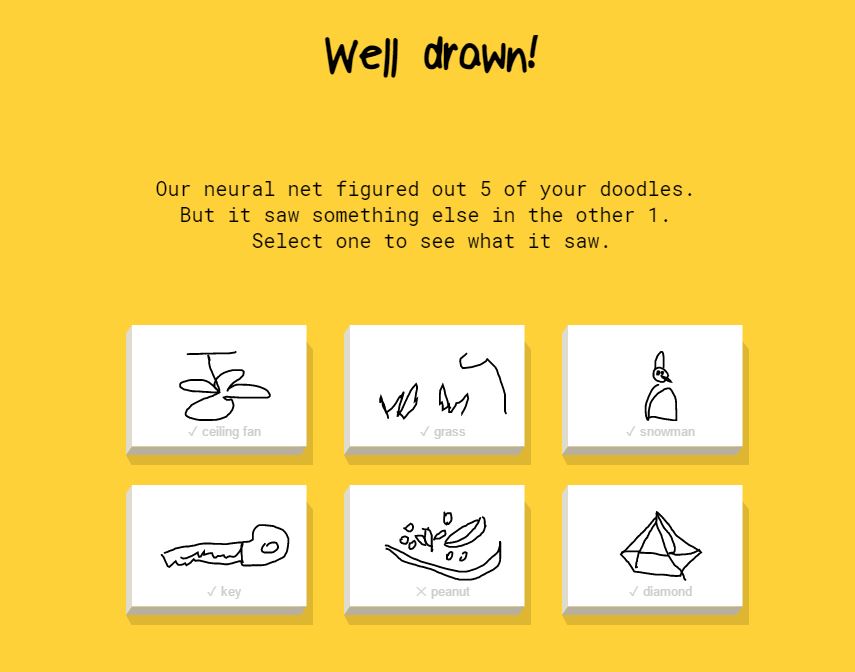

Hace un tiempo empecé a preguntar en mis charlas «¿Sabes buscar por imágenes en Google?» a lo que invariablemente me responden «¡Por supuesto! ¡…buscas las palabras en Google y luego haces click en Imágenes!». Algunos se sorprenden cuando les digo que eso es encontrar imágenes buscando por texto, que pueden buscar por imágenes directamente.

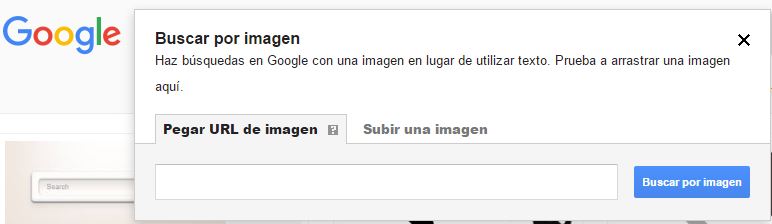

…sí, llegamos hasta aquí, pero luego tenemos que pulsar el ícono de la cámara fotográfica y ahora si buscar JPG, GIF…

…y entonces aquí sí, subiendo una imagen de muestra o indicando su dirección, «buscaremos por imágenes»

Lo que ha hecho Google ahora es ir un paso mas y lanzar una serie de experimentos basados en procesamiento por inteligencia artificial, disponibles online, alimentados por sus servicios en la nube que cualquiera puede usar y jugar con ellos. La imagen que encabeza el post es el resultado de mis respuestas en Quick, Draw! donde en 20 segundos tuve que dibujar diferentes conceptos, sin previo aviso y con el ratón, aunque podría haber participado con el móvil para que los dibujos no fueran tan horrendos (lo de los cacahuetes no tiene excusas). Incluso desde el reloj podría haber sido mejor. Sin embargo, a los restantes cinco dibujos, el motor de Google los reconoció casi inmediatamente (lo del ventilador de techo del comienzo es un verdadero prodigio … de inteligencia artificial 🙂 )

Resulta adictivo y fascinante, con implicaciones mucho más amplias sobre redes de auto-aprendizaje, en áreas clave de investigación de IA como el reconocimiento de imágenes y reconocimiento óptico de caracteres. Pero si lo traigo a mis aguas de marca y empresa pienso en aplicaciones: cafeteras que entiendan mi necesidad de un cortado a través de un gesto, televisores que entiendan nuestro estado de ánimo reconociendo nuestras caras y nos recomienden contenidos afines a éstas o ya rizando el rizo, neveras que congelen mas rápido las latas de cerveza porque delante del televisor estamos a punto de festejar que nuestro equipo sale campeón (detectable por nuestras caras de ansiedad).

Al mismo tiempo, recuerdo cuando Samsung retiró sus TV que hacían este ejercicio predictivo escuchando nuestra voz o al estar conectado por WiFi a nuestro smartphone (gracias a Facebook que cotillea todos los sensores del teléfono). En ese momento prevaleció el miedo y la tecnofobia. (como en nomofobia 1, nomofobia 2, y restantes)

En tan sólo dos años, ya podemos hablar de nueva tecnofilia. Aunque de momento sólo sea Google quien reconozca un garabato mal dibujado en su aplicación.